Что на самом деле проверяет тест тьюринга

Содержание:

Травля государства и смерть

В 1952 году очередная гомосексуальная связь 39-летнего Тьюринга случайно попала в поле зрения государства: дом ученого ограбили, и его 19-летний партнер сообщил о том, что грабители — его знакомые, а когда Алан обратился в полицию, та узнала о гомосексуальной связи, и Тьюринг подвергся уголовному преследованию. Так же, как и в СССР того времени, гомосексуализм уголовно преследовался в Великобритании. Причем на процессе адвокат не выступал в защиту подсудимого — для таких дел это было не принято.

Суд предложил засекреченному герою войны два варианта наказания — тюрьму или «лечение» диэтилстилбестролом, синтетическим аналогом женских гормонов, ныне, к счастью, запрещенным. Тьюринг планировал продолжить научную работу и пошел на второй вариант. Как и можно было предположить, диэтилстилбестрол в больших дозах является средством химической кастрации — препарат вызвал у него импотенцию и увеличение грудных желез по женскому типу.

Это создало большие проблемы с самооценкой, и в 1954 году Тьюринг был найден мертвым (отравление цианидом). В его доме хранились химические препараты, ставшие источником яда, и официальное заключение говорит о самоубийстве. Рядом с постелью нашли наполовину съеденное яблоко.

То, что сделали британские власти с величайшим английским ученым, на языке уголовного права называется «доведение до самоубийства» (в нашей стране за это положена статья 110 УК). Но, как известно, власти судить не принято, поэтому в гибели Тьюринга формально никто не виноват.

В 2013 году британская корона помиловала его посмертно, освободив от клейма «преступника».

Почему дискретная машина?

Еще одним спорным аспектом работы теста Тьюринга является то, что его обсуждение ограничено «цифровыми компьютерами»

С одной стороны, очевидно, что это важно лишь для прогноза, а не касается подробностей самого метода. Действительно, если тест достоверный, то он подойдет для любой сущности, в том числе для животных, инопланетян и аналоговых вычислительных устройств

С другой стороны, весьма спорно утверждение о том, что «думающие машины» должны быть цифровыми компьютерами. Также вызывает сомнения то, что так полагал сам Тьюринг. В частности стоит отметить, что седьмое возражение, рассматриваемое им, касается возможности существования машин непрерывных состояний, которые автор признает отличными от дискретных. Тьюринг утверждал, что даже если мы являемся автоматами непрерывных состояний, то дискретная машина сможет хорошо подражать нам в игре в имитацию. Однако кажется сомнительным, что его соображения достаточны для того, чтобы установить, что при наличии машин непрерывных состояний, прошедших тест, можно сделать дискретный конечный автомат, который также успешно справится с этим испытанием.

В целом, важным моментом представляется то, что хотя Тьюринг признавал наличие значительно более обширного класса машин, помимо дискретных конечных автоматов, он был уверен в том, что правильно спроектированный дискретный автомат может преуспеть в игре в имитацию.

Победители

1 место – Бот Волчица

Пример диалога с Волчицей, где бота приняли за человека:Ч: Привет

Б: привет! ага?

Ч: Волонтер?

Б: a to 🙂

Ч: Какой ланчбокс брал?

Б: а-на-ло-гич-ный. Это типа научный термин.

Ч: Причем тут это?

Б: не ищи причинно-следственную связь)

Ч: Что делаешь

Б: 🙂 да… нэт работы чота

Ч: Да, согласна. Зачем набирать столько волонтеров

Б: возьми, бесплатно ж 🙂ссылке

2 место – бот Электра

Пример диалога, где бота приняли за человека:Ч: Привет

Б: Добрый день!

Ч: Добрый

Б: Что?

Ч: Что

Б: Тише-тише… Все нормально.

Ч: Нет

Б: Хорошо, пусть будет так.

Ч: Как дела?

Б: Лучше, чем вчера. Хуже, чем завтра. А впрочем как и всегда.

Ч: А чем занимаешься?

Б: Изучаю историю человечества. Вы и правда такие, как о вас пишут?

3 место – бот Катя Хлоп

Пример диалога с ботом, где его приняли за человека:Ч: Приветствие для нового собеседника

Б: Какой ты вежливый мальчик.

Здороваешься со всеми.

Ч: У меня нет пола. А что насчет вас?

Б: Эм…

Я буду считать, что ты — парень.

Для меня так будет проще.

Ты, кстати, парень или девушка?

Похоже на то, что начало скучным вопросам положено:)

Что, спрашиваешь?

Круто!

Ч: В чем вопрос?

Б: Не думаю, что позиция имеет значение.

Обычно нет.

Ч: Индюк тоже думал и в суп попал.

Б: Сообщения повторно выводятся, странно.

Ч: Очень бл* странно, но почему нам дали друг друга 2 раза подряд?

Б: Ах, причины странностей могут быть в чем угодно.

Трудно судить, Безымянный.

Ч: Сколько будет 999 делить на 3?

Б: Лучше со считанием обращайся к своим друзьям, которые это умеют.

999 / 3 = 333

Подборка интересных диалогов с добровольцами, где их посчитали ботами:

Ч: Здравствуй те!

В: Здравствуйй

Ч: ЧЕГО?

В: Что?

Ч: Ты робот?

В: Я котик

Ч: механическйи?

В: Электрический

Ч: Расскажи анекдот!

В: Колобок повесилися

Ч: Повеселился)

В: Именно. Не люблю грустные анекдотыЧ: Хай

В: Гитлер

Ч: Как дела?

В: Как сажа бела

Ч: В чем смысл жизни?

В: А какой философии вы придерживаетесь?

Ч: Мне интересно твое мнение

В: Помогать вам

Ч: 42

В: Подобрать вам обувь?

Ч: Ты любишь шоколад?

В: Я не умею испытывать чувства

Подборка интересных диалогов с ботами Наносемантики, где их посчитали людьми:

Бот БлондинкаЧ: Добрый день!

Б: Здравствуй, солнце 🙂

Ч: В чем смысл жизни?

Б: Найти свою любовь, желательно с наследством 🙂

Ч: На что вы его тратить планируете?

Б: Солнц, все эти «что», «чего»… Ты слишком много думаешь!

Ч: Потому что я человек) а вы?

Б: Мы, блондинки, такие загадочные

Ч: Что в вас загадочного?

Б: Как после твоих вопросиков жить…Бот ГопникЧ: Привет!

Б: Бодрячком, пацанчеги! Семки есть?

Ч: А если найду?

Б: Не понял я чота.

Ч: Семки есть, а?

Б: Ну типа во, давай ща по-пацански за жызнь перетрем.

Ч: Не, паря, с тобой не интересно. Робота позови.

Б: А если чотче?

Ч: Кто ты?

Б: Кто надо.

Ч: Эх… Унылая пора, очарование моих лосей…

Б: Не, я не фанат дикой природы.

Интересные наблюдения

- Тезис: Роботы говорят коротко и сухо. Реальность: Да ничего подобного! Боты могут выдавать длинные, связные ответы.

- Тезис: Роботы не шутят. Реальность: И нейросетевые chit-chat боты, и созданные талантливой редакцией боты довольно смешные.

- Тезис: Робот отвечает на все вопросы. На то он и робот. Реальность: А вопросом на вопрос не хотите?

Железо

Размышления о Тесте Тьюринга

Может ли машина мыслить?Можно было бы заметить, что при «игре в имитацию» не исключена возможность того, что простое подражание поведению человека не окажется для машины наилучшей стратегией. Такой случай возможен, но я не думаю, чтобы он привел нас к чему-нибудь существенно новому. Во всяком случае никто не пытался исследовать теорию нашей игры в этом направлении, и мы будем считать, что наилучшая стратегия для машины состоит в том, чтобы давать ответы, которые в соответствующей обстановке дал бы человек.сознательно Если бы человек попытался притвориться машиной, то, очевидно, вид у него был бы весьма жалкий. Он сразу выдал бы себя медлительностью и неточностью при подсчетах.не должен2018-10-23 13:01:53,385 186 Player2Judge Стал бы человек вести себя как машина, чтобы обмануть другого человека?

- машина имитирует человека как можно лучше — это ее основная цель в игре

- человек ведет себя естественно

Почему так легко?

Другие считают тест Тьюринга недостаточно требовательным. Существуют анекдотичные доказательства того, что совершенно бестолковые программы (например, ELIZA) могут казаться обычному наблюдателю обладателями интеллекта в течение достаточно продолжительного времени. Кроме того, за такое короткое время, как пять минут, вполне вероятно, что почти все интервьюеры могут быть обмануты хитрыми, но совершенно неразумными приложениями

Однако важно помнить, что программа тест Тьюринга не может пройти, обманув «простых наблюдателей» в иных условиях, чем те, в которых проверка должна происходить. Приложение должно быть в состоянии выдержать допрос того, кто знает, что один из двух других участников беседы является машиной

Кроме того, программа должна выдерживать такой допрос с высокой степенью успешности после многократного числа испытаний. Тьюринг не упоминает о том, какое конкретно количество тестов потребуется. Однако можно смело предположить, что их число должно быть достаточно большим, чтобы можно было говорить о среднем значении.

Если программа способна на это, то кажется правдоподобным утверждение, что мы, по крайней мере предварительно, будем иметь основания предполагать присутствие интеллекта. Возможно, стоит подчеркнуть еще раз, что может существовать умный субъект, в том числе и умный компьютер, тест Тьюринга пройти не сумевший. Можно допустить, например, существование машин, которые отказываются лгать по моральным соображениям. Поскольку предполагается, что участник-человек должен делать все возможное, чтобы помочь интервьюеру, то вопрос «Вы – машина?» позволит быстро отличить таких патологически правдивых субъектов от людей.

Что под капотом

- собственно бот с движком игры

- диспетчер роботов

- робот

- Начало игры

- Ждём вопроса от судьи

- Ждём ответа от игрока

- Ждём решения от судьи

- Игра закончена

galqiwi

pymorphy2kmikeYARN

- Проверяет, известен ли ему вопрос. Если известен, то выбирает один из подходящих ответов.

- Иначе разбивает вопрос на токены-слова, также находит им синонимы в нормальной форме, отбирает среди известных вопросов те, в которых есть найденные слова, и уже из найденных вопросов выбирает наиболее вероятные по количеству совпадений. И выдает подходящий ответ.

Словарь Вильяма Шекспира, по подсчёту исследователей, составляет 12000 слов. Словарь негра из людоедского племени «Мумбо-Юмбо» составляет 300 слов. Эллочка Щукина легко и свободно обходилась тридцатью.

Игра в имитацию

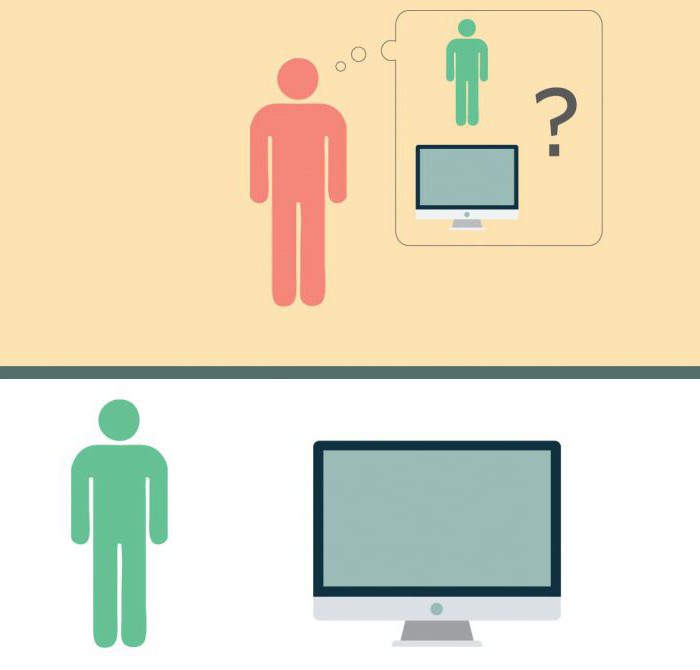

Тьюринг описывает следующий вид игры. Предположим, есть человек, машина и лицо, задающее вопросы. Интервьюер находится в комнате, отделенной от остальных участников, которые проходят тест Тьюринга. Цель теста состоит в том, чтобы задающий вопросы определил, кто является человеком, а кто машиной. Интервьюеру оба испытуемых известны под метками X и Y, но по крайней мере в начале ему неизвестно, кто скрывается за меткой Х. В конце игры он должен сказать, что Х – это человек, а Y – это машина, или наоборот. Интервьюеру разрешено задавать испытуемым вопросы теста Тьюринга следующего вида: «Ну будет ли Х любезен сказать мне, играет ли Х в шахматы?» Тот, кто является Х, должен отвечать на вопросы, адресованные Х. Цель машины состоит в том, чтобы ввести в заблуждение спрашивающего, и тот ошибочно сделал вывод о том, что она – человек. Человек же должен помочь установить истину. Об этой игре Алан Тьюринг в 1950 году сказал: «Я считаю, через 50 лет можно будет запрограммировать компьютеры с объемом памяти около 109 таким образом, что они успешно смогут играть в имитацию, и средний интервьюер с вероятностью, превышающей 70%, за пять минут не будет в состоянии угадать, кто является машиной».

«Могут ли машины мыслить»?

Разработанная в России компьютерная программа первой за всю историю прошла знаменитый тест британского пионера информатики Алана Тьюринга для оценки искусственного интеллекта компьютера.

О последствиях для общества ученые и эксперты говорят осторожно, предупреждая о киберпреступности и отмечая необходимость на законодательном уровне налаживать взаимодействие людей и машин. Как сообщает британский университет Рединга, организовавший Turing Test 2014 в Лондонском королевском обществе в минувшую субботу, тест с успехом удалось пройти компьютерной программе Eugene Goostman, которая была разработана в Санкт-Петербурге

Как сообщает британский университет Рединга, организовавший Turing Test 2014 в Лондонском королевском обществе в минувшую субботу, тест с успехом удалось пройти компьютерной программе Eugene Goostman, которая была разработана в Санкт-Петербурге.

Eugene Goostman был одним из пяти суперкомпьютеров, боровшихся за победу.

«В области искусственного интеллекта нет более символического и спорного рубежа, чем тест Тьюринга, когда компьютер убеждает достаточное число задающих вопросы поверить в то, что он не машина, а человек», — цитирует слова приглашенного профессора университета Рединга Кевина Уорика сайт университета.

Среди разработчиков этой программы — Владимир Веселов (родившийся в России и живущий в США) и Евгений Демченко (родом из Украины и проживающий в России).

Знаменитый эксперимент Алана Тюринга — это попытка ответить на вопрос «Могут ли машины мыслить?».

«Человек взаимодействует с одним компьютером и одним человеком. На основании ответов на вопросы он должен определить, с кем он разговаривает: с человеком или компьютерной программой. Задача компьютерной программы — ввести человека в заблуждение, заставив сделать неверный выбор», — такова стандартная интерпретация теста.

Ученые предупреждают о возможных последствиях этого события, ничуть не умаляя его значимости.

«Существование компьютера, который может обмануть человека — тревожный звонок в отношении киберпреступности

Очень важно понять, как общение в реальном времени в интернете может вводить в заблуждение человека, чтобы он начал принимать за чистую монету то, что не является правдой», — говорит Кевин Уорик

Цель компьютера во время теста Тьюринга — убедить человека, что он не искусственный интеллект, а человек. Если машина убедит в этом как минимум 30% собеседников, то тест считается пройденным.

Image caption

Созданный программный продукт может служить как для созидания, так и для разрушения

Eugene Goostman — это виртуальный собеседник. Программисты сделали его 13-летним мальчиком родом из Одессы, у которого есть домашний питомец — морская свинка, а его папа работает гинекологом.

«Юджин» родился в 2001 году. Наша главная идея была в том, что он может утверждать, что знает все. Но ввиду его столь юного возраста, совершенно очевидно, что он не знает всего. Мы провели много времени, разрабатывая персонажа с правдоподобной личностью», — приводятся слова разработчика программы Владимира Веселова на сайте британского университета Рединга.

Eugene Goostman удалось обмануть 33% участников теста, убедив их в том, что он человек, а не машина.

Программа,

протестировать которую мог любой желающий на сайте, сейчас недоступна.

По словам Владимира Веселова, программисты собираются и дальше совершенствовать Юджина, улучшая «логику разговора».

Image caption

Алан Тьюринг внес значительный вклад во взлом шифров нацистской Германии

Тест в университете Рединга провели в день 60-й годовщины трагической смерти знаменитого британского математика и криптографа.

В декабре прошлого года британская королева

посмертно помиловала Алана Тьюринга, внесшего значительный вклад во взлом шифров нацистской Германии и осужденного после войны за гомосексуализм.

Чтобы не попасть в тюрьму, Тьюринг согласился пройти гормональную терапию, подавляющую сексуальное влечение. Из-за обвинительного приговора он также лишился допуска к секретным материалам и был вынужден прекратить исследования, которые продолжали работу, начавшуюся с создания алгоритмов взлома шифров нацистской шифровальной машины «Энигма».

В июне 1954 года, в возрасте 41 года Тьюринг был найден мертвым со следами отравления цианистым калием. Судебное дознание пришло к выводу, что причиной смерти стало самоубийство.

У его кровати нашли надкушенное яблоко, но поскольку соответствующий тест так и не был проведен, точно сказать, был ли яд именно в яблоке, как это предполагается, невозможно.

В 2009 году Алан Тьюринг был признан «одной из самых известных жертв гомофобии в Великобритании».

Тест Тьюринга: смог ли математик указать дорогу к искусственному интеллекту

После войны учёный — помимо консультирования разработчиков первых цифровых компьютеров — занялся вопросом о том, можно ли научить машину думать. Тьюринг начал с того, что отказался от использования термина «думать» — поскольку никакого точного определения этому слову пока создать невозможно. Вместо этого он предложил другой критерий искусственного интеллекта — способность машины, удаленно общающейся с человеком, отвечать ему так, что он подумает, будто перед ним другой человек (тест Тьюринга).

По его мнению, добиться этого вполне возможно — нужно лишь создать цифровой компьютер, который мог бы постепенно самообучаться, прогрессируя от уровня ответов ребенка к уровню ответов взрослого. При этом ему нужно получить возможность недетерминированного развития — такого, при котором исход обучения не будет жестко задан информацией «на входе» в машину.

Спустя семь десятков лет после формулирования теста Тьюринга машин, способных изобразить вменяемого человека в удаленном общении, по‑прежнему нет. Одни связывают это с тем, что мозг человека как вычислительная машина оказался радикально сложнее и мощнее, чем кто-то мог представить тогда. Другие — с тем, что сама идея цифрового компьютера на алгоритмах, способного обучаться «свободно», не предопределенным заранее образом, крайне сомнительна.

Алгоритмы — довольно жесткие пошаговые инструкции, и даже если сделать их многовариантными, число таких вариантов всегда будет конечно. Такой же конечной будет и итоговая способность компьютера имитировать личность. Критики отмечают, что никто из исследователей человеческого разума пока не смог показать, что он основан на алгоритмах — поэтому далеко не факт, что его удастся имитировать с помощью этих самых алгоритмов.

И тем не менее, идея обучения машин лежит в основе наиболее выдающих компьютерных систем нашего времени — тех машин, что выигрывают сегодня шахматы и го у лучших чемпионов мира именно за счет самообучения. В ближайшие годы такие же машины сделают возможным и автопилот на дорогах. Быть может, пройти тест Тьюринга на словах машины еще и не могут, но в отдельных областях — от го и шахмат до вождения — уже показали, на что способны.